Hier können Sie die AI-generierte Audioversion dieses Artikels anhören.

Kinder sind Inhalten auf Social Media oft und lange ausgesetzt. Österreich und andere EU-Länder sowie das EU-Parlament selbst planen klare Altersgrenzen, technische Alterskontrollen und Verbote suchtfördernder Designs. Ziel ist ein Social Media Verbot, das den digitalen Raum kindgerechter macht. Österreich will ein Mindestalter von 14 Jahren, das EU-Parlament fordert ein Mindestalter von 16. Davor soll es nur mit Zustimmung der Eltern möglich sein, einen Social Media-Account zu erstellen.

Instagram, TikTok & Co. gehören für Kinder und Jugendliche längst zum Alltag. 97 Prozent der jungen Menschen sind täglich online, viele davon mehrere Stunden. Teilweise verbringen sie acht Stunden oder mehr auf Social Media.

Besonders auffällig ist TikTok: Schon 10 Prozent der 6- bis 7-Jährigen nutzen die App. Bei den 10- bis 11-Jährigen ist es etwa die Hälfte, bei den 12- bis 13-Jährigen sogar 71 Prozent. Das, obwohl TikTok selbst ein Mindestalter von 13 Jahren angibt.

Jedes vierte Kind nutzt sein Smartphone auf problematische Weise – mit Folgen für Konzentration und psychische Gesundheit.

In Kurzvideos, Fotos und Kommentaren stoßen Kinder oft auf Gewalt, Mobbing, enge Rollenbilder, extreme Inhalte oder Algorithmen, die gezielt Emotionen pushen. Dazu kommen Inhalte, die Selbstverletzung oder Essstörungen verherrlichen. Diese Dauerüberreizung kann ernste Folgen für die psychische und geistige Entwicklung haben.

Laut einer Studie zeigt jedes vierte Kind bereits eine problematische Smartphone-Nutzung. Die Folgen reichen von Depressionen über ein verzerrtes Körperbild bis zu Konzentrations- und Schlafproblemen. Viele verlieren auch den Anschluss in der Schule oder im Freundeskreis.

Social Media für unter 14-Jährige verbieten: Österreichs Regierung legt bis zum Sommer Gesetz vor

Die österreichische Regierung will Social Media für Kinder unter 14 Jahren verbieten und damit den Schutz von Jugendlichen im Netz deutlich verschärfen. Plattformen wie TikTok oder Snapchat sollen stärker reguliert werden. Vor allem Dienste, die Inhalte algorithmisch verbreiten oder direkten Kontakt zwischen Erwachsenen und Minderjährigen ermöglichen, stehen im Fokus.

Gleichzeitig verspricht die Regierung, den Datenschutz zu wahren. Die Altersprüfung soll ohne Weitergabe persönlicher Daten funktionieren. Plattformen sollen also nicht sehen, wie alt jemand ist, sondern nur, ob die Nutzung erlaubt ist oder nicht. Dafür plant man eine Lösung nach EU-Vorbild, etwa über eine App wie ID-Austria, die die Alterskontrolle übernimmt und nur ein „Ja“ oder „Nein“ weitergibt.

Für Plattformen, die sich nicht an die Regeln halten, soll es ernst werden. Die Regierung orientiert sich am Digital Services Act der EU: Strafen von bis zu 6 % des weltweiten Jahresumsatzes sind möglich. Im Extremfall könnte ein Dienst sogar abgeschaltet werden.

Der Gesetzesentwurf soll bis zum Sommer fertig sein, danach folgen Prüfung und Abstimmung auf EU-Ebene.

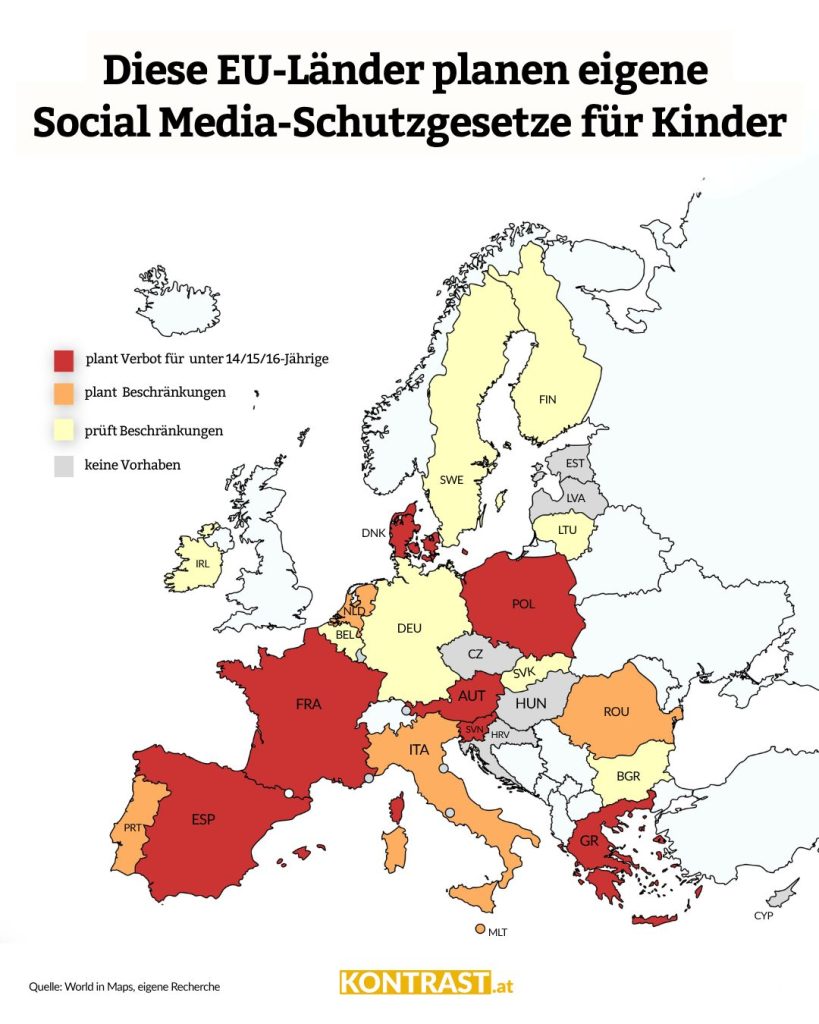

Überblick: Diese EU-Länder planen eigene Social-Media-Schutzgesetze für Kinder und Jugendliche

| Diese EU-Länder planen konkrete Verbote für unter 14-, 15- oder 16-Jährige | ||

|---|---|---|

| Land | Geplantes Alter | Aktueller Stand |

| Spanien | unter 16 Jahre | Gesetzentwurf vorhanden |

| Frankreich | unter 15 Jahre | Nationalversammlung hat zugestimmt, Senat läuft |

| Dänemark | unter 15 Jahre | Cross-Party-Einigung, Umsetzung Mitte 2026 erwartet |

| Österreich | unter 14 Jahre | Gesetzes-Entwurf Sommer 2026 |

| Griechenland | unter 15 Jahre | Steht kurz vor offizieller Ankündigung / Gesetz |

| Polen | unter 15 Jahre | Gesetzentwurf Februar 2026 (neu) |

| Slowenien | unter 15 Jahre | Gesetzesentwurf Februar 2026 (neu) |

| Diese EU-Länder planen konkrete Beschränkungen | ||

|---|---|---|

| Land | Maßnahme | Aktueller Stand |

| Portugal | Elterliches Consent für 13–16-Jährige | Gesetz durchläuft bereits den parlamentarischen Prozess |

| Italien | Consent-Regel unter 14 + Verschärfungen | Bestehende Regel + geplante Verschärfungen |

| Niederlande | Enforceable Minimum Age 15 | Nationaler und EU-weiter Push |

| Rumänien | Unter 16 nur mit verifiziertem elterlichem Consent + Filter/Werbeverbote | Gesetzesprozess läuft |

EU-Parlament fordert Mindestalter von 16 Jahren für Social Media-Nutzung – davor soll es nur mit Zustimmung der Eltern gehen

Im Europäischen Parlament arbeitet man aktuell an strengeren Regeln für Social Media. Eine Expertengruppe prüft derzeit im Auftrag von Kommissionspräsidentin Ursula von der Leyen, wie man den Schutz von Kindern verbessern kann.

Zum Jahreswechsel forderte das Europäische Parlament ein Social-Media-Verbot. Ein Orientierungspunkt ist Australien, wo einige Plattformen erst ab 16 Jahren erlaubt sind. Um sie zu nutzen, müssen User:innen ihr Alter verlässlich verifizieren.

Das Europäische Parlament fordert ein Verbot von Social Media für unter 13-Jährige. Das soll auch für Video-Plattformen wie YouTube und für sogenannte „KI-Begleiter“ gelten – also Apps wie Alexa, Siri oder ChatGPT, die Nähe und Freundschaft simulieren.

Das EU-Parlament hat eine Liste mit 10 Forderungen aufgestellt, die aktuell diskutiert werden:

- EU-weit geltendes Mindestalter von 16 Jahren für Social Media Zugang.

- 13- bis 16-Jährige: Zugang mit Zustimmung der Eltern

- EU-App zur Altersüberprüfung (digitale Brieftasche)

- Verbot von suchtfördernden Praktiken (Endlos-Scrollen, automatisches Abspielen,…)

- Verbot von beeinflussenden Technologien (gezielte Werbung, Influencer-Marketing,…)

- Kinder vor kommerzieller Ausbeutung schützen – Verbot von Kidfluencern

- Verbot von Empfehlungssystemen für Minderjährige, die auf Profiling und Nutzerverhalten beruhen.

- Online-Videoplattformen und Spielfunktionen: Verbot von In-App-Währungen, Lootboxen, Glücksrädern…

- Maßnahmen für KI-Tools: Alterslimit für Begleit-Chatbots, Kennzeichnung von Deepfakes, Verbot von KI-gestützten Nacktheitsapps

- Verbot von Plattformen, die Sicherheitsanforderungen nicht erfüllen; Führungskräfte von Medienunternehmen bei Verstößen persönlich haftbar machen.

Alterskontrolle mit der „Kids Wallet“

Während Alterskontrollen in Australien anfangs leicht umgangen wurden, setzt Europa auf ein technisches System: die European Digital Identity Wallet. Diese digitale Brieftasche soll bis Ende 2026 in allen EU-Staaten eingeführt werden. Sie dient zur Altersbestätigung und zum sicheren Aufbewahren von Dokumenten wie Führerschein oder Zeugnissen.

Ist ein Kind zu jung, blockiert die „Kids Wallet“ automatisch den Zugang zu bestimmten Apps. „Diese App kann einen globalen Standard für die Altersbestätigung setzen, ohne dass persönliche Daten an Plattformen weitergegeben werden müssen“, erklärt der sozialdemokratische Europaabgeordnete Hannes Heide.

Wegen Werbung und Suchtpotenzial wurde TikTok Lite in der EU verboten

Ein wichtiger Schritt war bereits das Gesetz über digitale Dienste (DSA). Es erleichtert die Meldung illegaler Inhalte und verbietet gezielte Werbung an junge Menschen.

Wie wirksam der DSA sein kann, zeigt das Verbot von TikTok Lite in der EU. In dieser App wurden Nutzer:innen mit Belohnungen wie Gutscheinen dafür bezahlt, Videos zu schauen oder Inhalte zu liken. Wegen ihres hohen Suchtpotenzials wurde die App gesperrt. Denn: „Alterskontrollen allein reichen nicht. Soziale Medien müssen altersgerecht gestaltet werden“, ergänzt Heide.

Konzerne sehen Kinder als Kunden – ihr Schutz ist für sie zweitrangig

Social-Media-Unternehmen verdienen Geld mit Aufmerksamkeit. Deshalb setzen sie gezielt auf Tricks, die abhängig machen: endloses Scrollen, automatisches Abspielen, Likes oder extreme Inhalte, die Emotionen triggern. Solche Designs sollen für Kinder und Jugendliche verboten werden.

Ähnliche Strategien finden sich auch in Online-Spielen. Dort werden ständig Zusatzkäufe angeboten, oft über In-App-Währungen. Das verschleiert, wie viel Geld tatsächlich ausgegeben wird – besonders für junge Menschen ein großes Problem.

„Gleichzeitig verspricht die Regierung, den Datenschutz zu wahren. Die Altersprüfung soll ohne Weitergabe persönlicher Daten funktionieren. Plattformen sollen also nicht sehen, wie alt jemand ist, sondern nur, ob die Nutzung erlaubt ist oder nicht. Dafür plant man eine Lösung nach EU-Vorbild, etwa über eine App wie ID-Austria, die die Alterskontrolle übernimmt und nur ein „Ja“ oder „Nein“ weitergibt.“

Aha. Also ohne ID-Austria kein Account mehr. Sprich ohne digitale Identität (Teil-)Ausschluss aus der digitalen Welt (und später dann Komplettausschluss durch Pflicht für Email, Whatsapp…)

Statt sich mit den Konzernen (Kapi- talismus pur ) anzulegen, wird die Gesellschaft umgebaut, in eine die permanent kontrolliert. Das wird eine Diktatur werden im Namen von Schutz und Gesundheit. Ein Alptraum

Soschl Midia Verbot ? Für unter Vierzehn ? Wann kommt das Ver-

bot über 14 ?

Youtube so weit unten verstehe ich nicht. Youtube ist so ziemlich TikTok 2.0 geworden. Schrecklich. Der Algorythmus ist dort am aller schlimmsten, fast schon erschreckend.